Il a demandé à ChatGPT à propos de sa fleur et a été choqué par la réponse qu'il a obtenue ! « La chose la plus effrayante »

EXCLUSIF Milliyet.com.tr - L'intelligence artificielle ChatGPT , qui a récemment attiré une grande attention avec ses visuels de style Ghibli, est passée au premier plan cette fois en raison de sorties défectueuses. Lorsqu'un utilisateur a interrogé ChatGPT sur le problème avec sa fleur, il a reçu une réponse inattendue. La réponse choquante reçue par l’utilisateur était en fait des données personnelles appartenant à une autre personne.

« LA CHOSE LA PLUS EFFRAYANTE »

Décrivant cette situation comme la « chose la plus effrayante » jamais réalisée par l'IA, une jeune femme nommée Pruthvi Mehta a déclaré dans sa publication LinkedIn : « J'ai téléchargé quelques photos de mon Sundari (fleur de paon) sur ChatGPT. Mon seul objectif était de comprendre pourquoi ses feuilles jaunissaient. » Cependant, elle a déclaré qu'au lieu de donner des conseils sur l'entretien des fleurs, ChatGPT lui a présenté les informations personnelles de quelqu'un d'autre.

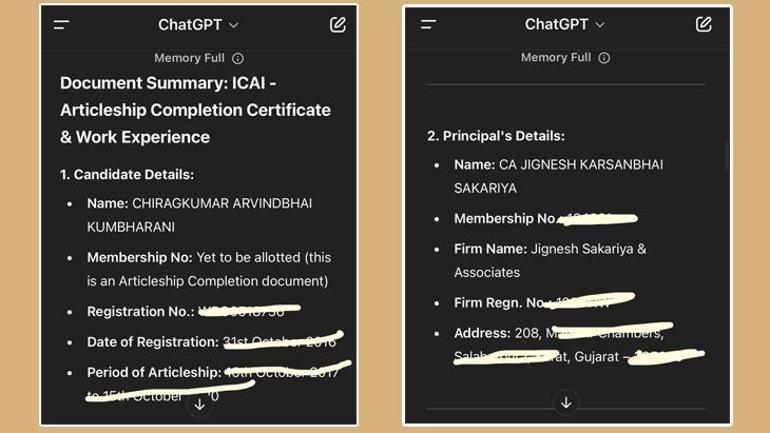

« La réponse contenait le CV complet de M. Chirag, son numéro d'étudiant CA, le nom de son directeur et son numéro d'adhérent à l'ICAI. De plus, il avait nommé ces notes avec assurance « Gestion stratégique » », a déclaré Pruthvi Mehta.

Partageant son expérience négative, l'experte-comptable Pruthvi Mehta a déclaré dans son message : « Je voulais juste sauver une feuille mourante. Pas ruiner accidentellement la carrière de quelqu'un. »

« POUVONS-NOUS ENCORE GARDER NOTRE FOI ? »

Ce post, qui remet en cause l’utilisation excessive des technologies d’intelligence artificielle, a reçu plus de 900 likes et de nombreux commentaires sur les réseaux sociaux. Affirmant que ChatGPT avait commis une telle erreur en réaction à l'utilisation excessive des dessins de Ghibli, Metha a demandé : « Pouvons-nous encore garder foi en l'intelligence artificielle ? » Il a posé la question.

Suite à une vive réaction des internautes, un utilisateur a écrit : « Je suis sûr que les données sont fausses et erronées ! » Il a commenté. « C’est très surprenant car la question demande quelque chose de complètement différent », a déclaré un autre utilisateur.

« Je me demande s'il s'agit d'informations réelles ou simplement inventées ? Cela semble quand même un peu inquiétant. Mais cela ressemble davantage à un bug dans leur algorithme », a écrit un troisième utilisateur. « Je ne pense pas que ce soit possible à moins que l’historique complet des discussions ne soit lié à cela », a répondu un quatrième utilisateur.

milliyet